1、量子计算机不是概念复兴,而是未来必然结果在摩尔定律放缓、AI算力需求指数级增长的背景下,经典计算正逼近物理与能耗边界。量子计算并非“更快的CPU”,而是在部分高价值问题上唯一可能突破复杂度上限的新物理计算范式。

2、量子计算的价值不在“量子比特数量”,而在系统工程能力盲目追求量子比特数量并不能有效提升整机性能,量子计算机的核心竞争力在于噪声控制、纠错机制、系统稳定性与软件栈之间的协同能力。3、算力架构的异构化融合与量子 ×AI 协同 量子计算不会取代经典计算,而是作为专用加速模块嵌入现有算力体系,QPU 的角色更接近AI 时代的GPU,仅在经典算力触顶的子问题中发挥决定性作用。在高维并行表达与大规模组合优化等问题上,量子计算与AI 在训练与推理过程中面临的复杂度瓶颈形成天然互补。

4、投资上应“多点布局”,避免押注式判断在技术路线尚未收敛的阶段,全栈整机、上游设备、软件算法与量子云平台都存在不同风险收益特征。押注单一路线容易放大技术不确定性与周期波动风险。

以下,各位enjoy。

01

前瞻

过去很长一段时间,量子技术一直被人们视为出现在科幻作品中的前沿概念,其现实意义更多停留在理论物理与基础研究层面,与实际产业应用之间存在明显距离。然而,随着实验体系不断成熟、工程化能力持续积累,以及产业资本与算力体系的逐步介入,量子计算正在从“可证明的科学现象”走向“可被工程化评估的技术方向”,行业讨论的重心也随之发生转变——从关注理论可行性,转向思考其现实可用性与发展路径。

在最新的“十五五”规划中,量子科技被明确纳入培育新质生产力的重要方向,其发展逻辑不再局限于强化基础研究本身,而是强调技术突破与应用探索的并行推进。这一变化意味着量子技术在国家科技体系中的定位正在发生升级:从基础科研学术储备,转向具备中长期产业潜力和战略价值的关键技术方向。

在此背景下,量子技术的关注主体也正在显著扩展。除科研机构持续投入外,产业界与资本开始以更现实、更系统的视角参与其中,关注焦点逐步从单点技术指标,转向工程能力、产业组织方式以及潜在应用场景的可行性。科研体系、产业链布局与应用需求之间的协同关系,正在成为决定量子技术下一阶段发展节奏和路径选择的核心变量。

02

为什么现在值得关注量子计算?

算力供需结构性缺口与未来趋势

近年来,我们看到经典半导体摩尔定律的增速明显放缓:晶体管制程接近物理极限,性能提升更多依赖堆叠芯片、特殊加速器等架构优化。与此同时,人工智能和高性能计算的算力需求呈指数级爆发式增长:AI训练所需的计算资源每隔3–4个月就翻一番,而传统芯片的性能约每三年翻一番。结果是算力供给增长的线性放缓与算力需求的指数激增之间出现了巨大的结构性缺口。

在这种背景下,业内普遍认为高价值的计算场景必须向新的物理计算范式迁移,其中被认为极具潜力的替代方案就是量子计算。简而言之,当经典计算方法难以再提供指数级算力时,量子计算作为利用量子叠加和纠缠特性的全新模型,正在成为填补这一缺口的关键候选者。此外,量子计算与当前芯片异构集成趋势相符:例如NVIDIA推出的NVQlink技术,旨在将量子处理单元(QPU)与GPU互联,实现量子–经典混合计算,正预示着量子算力可能与现有算力架构协同发展。种种迹象表明,量子计算正处在拐点的前夕,未来3–5年有望迎来指数式突破。

03

量子计算有什么独特之处?

一、量子计算与经典计算的差异量子计算与经典计算的根本差异,本质上源于其物理信息处理模型的范式转移。在经典计算体系中,信息的存储与处理受限于二进制比特的确定性状态;而在量子系统中,由于量子力学叠加特性的存在,一个量子比特可以同时处于“0”和“1”的叠加态,这为计算过程提供了前所未有的并行基础。更进一步地,多个量子比特之间可以通过量子纠缠建立非局域关联,这种关联使得系统的整体状态无法被简单地拆分为独立单元的累加,从而在指数级的状态空间中实现了信息的并行演化。相比之下,经典计算只能以串行方式或通过增加硬件规模实现有限的并行处理,这在处理极高复杂度的问题时显得捉襟见肘。

二、量子计算的优势量子计算价值的关键在于它并非仅仅是传统意义上的“运行更快”,而是引入了一种与物质世界物理规律更加匹配的计算架构。对于许多本质上遵循量子力学规律的难题,如分子动力学模拟、新型材料的微观结构分析以及复杂的量子态优化问题,量子计算机的信息单元天生具备叠加与干涉规律,这使得计算机在运行过程中本身就相当于“成为了被模拟的系统”,从而提供了解决此类问题的唯一合理且高效的路径。

三、量子算法的体现在算法实现的层面,这种独特性已经展现出了颠覆性的力量。例如,Shor算法正是巧妙地利用了量子的相干干涉特性,在处理大整数分解这一公认的数学难题上实现了相对于经典算法的指数级加速;而Grover搜索算法则通过干涉机制对未排序数据库进行检索,在概率层面上实现了平方级的效率提升。

总而言之,量子计算的真正魅力在于其能够物理性地、并行地探索海量的解空间,通过操纵概率幅的干涉来锁定正确答案,这种飞跃并非依靠增加硅芯片的开关频率或晶体管密度,而是来自于对量子叠加、纠缠和干涉等独特物理潜能的深度开发。

04

哪些应用场景已经可见进展?

一、科研与量子模拟目前量子计算最先取得实际成效的领域是基础科研和量子模拟。这是因为许多前沿物理、材料、化学问题本身就是量子系统,用传统超算模拟需要穷举海量态空间而近似误差巨大。量子计算天然模拟量子体系,例如模拟高温超导、量子相变、拓扑材料等,不再是对系统的逼近模拟,而是让计算机“真实地成为”物理系统,以费曼提出的“模拟式量子计算”原理来演绎。更重要的是,科研应用往往对结果精度的容忍度较高,几十到上百个高保真度量子比特的“含噪中型量子设备”(NISQ)就能为物理定律验证和趋势性研究提供有价值信息。这些科研机构愿意率先将任务投入现有量子设备,是构建全栈生态和实用算法的重要跳板。

二、生物医药虽然长期被认为量子计算最具颠覆潜力的新药研发领域,但目前技术门槛仍很高。量子计算能够从第一性原理直接模拟药物分子的电子结构和结合能,比传统DFT或分子动力学等近似方法更真实。然而一个典型蛋白质配体复合物往往包含上千电子自由度,即使是变分量子本征求解(VQE)算法也需要数千逻辑量子比特才能精确求解。因此,在可见的短期内,大多数研究集中在两个方向:一是开发降维策略,将复杂体系映射为简化的模型保留关键特征;二是利用量子-经典混合算法(如VQE+经典优化)进行协同计算;此外也有研究引入量子神经网络协助初筛,大幅提高通量筛选效率。总而言之,生物医药的量子化应用是未来5–10年级别的长期布局,目前更多在学术和实验验证阶段,尚未形成大规模商业模式。

三、化学与新材料与生物分子相比,化学材料系统规模通常更小(例如电池材料、催化剂等),规则性更强,对量子比特数量的要求相对低一些(几百个纠错比特级别就有潜力带来价值提升)。量子计算能够在不引入密度泛函理论等简化假设的前提下,直接求解多体薛定谔方程,例如计算分子轨道能级、催化反应路径、电子跃迁能谱等。这使得研究者已经成功地在实验室环境中用量子算法精确模拟了小分子(如氢分子、锂氢分子)及部分反应路径,并计划逐步扩展到过渡金属化合物、高熵合金等复杂体系。化学材料领域的特点是应用需求与量子计算能力“刚需”程度高:一旦实现足够规模的量子模拟,就能显著缩短新材料设计周期,因此被视为中期(3–5年内)实现商业化突破的重要赛道之一。

四、金融科技量化金融问题往往高度结构化且数值密集,如资产组合优化、风险模拟、路径依赖期权定价等,都是经典计算中的NP困难或近NP困难问题。量子计算的主要优势体现在三个方面:一是组合优化(如投资组合配置)可以使用量子近似优化算法(QAOA)实现指数级的搜索空间压缩;二是随机过程模拟(如蒙特卡洛定价)可借助量子振幅估计实现二次加速;三是衍生品定价中可以利用量子傅里叶变换和线性方程求解来快速提取模型参数,从而提升定价和对冲效率。相比于医药和材料领域,金融任务对计算精度的容忍度更高,因此几十到上百个物理量子比特即可运行有效的混合算法。目前已有一些原型量子算法在云平台上进行了验证(如信用风险聚类、收益率拟合等),反馈周期快、商业需求明确,使金融成为量子算法验证和迭代的重要“试验田”。总体来看,金融科技是量子计算短期内最有可能落地的应用领域之一。

05

与算力架构的关系

一、算力瓶颈下的范式迁移如上所述,经典摩尔定律放缓与AI算力需求激增构成了量子计算兴起的外部背景。业界普遍认为,当经典算力增长无法满足需求时,“高价值计算场景将开始迁移到物理层面更高效的计算体系上,目前唯一具备这一潜力的选择是量子计算”。这并非因为量子计算对所有任务都“更快”,而是因为在某些核心问题的物理模型层面,量子方案更匹配问题本身。如同2015年前夕深度学习与GPU算力的临界交汇一样,我们判断未来3–5年当有效量子比特数突破关键门槛后,量子算力也可能出现拐点式跃升。

二、从“纯量子机”到异构混合在技术演进路径上,量子计算未来最主流的形态很可能并非“纯量子机”,而是CPU/GPU/QPU混合协同的异构系统,即在同一个系统中同时运行传统计算和量子计算任务。换言之,量子处理单元(QPU)更类似于AI时代的GPU:它不会取代CPU或GPU,而是作为专门解决组合优化、量子化学等问题的加速模块,嵌入到传统计算体系中。例如,在药物分子模拟中,研究人员往往先使用GPU 对大量分子进行粗略筛选和能级估算,然后将最难计算的部分交给QPU 进行高精度求解,从而更准确地找到最优候选结构。

未来的混合算力架构中,CPU负责调度与控制、GPU负责大规模并行数值计算,而QPU则处理经典算力在复杂度或资源消耗上已接近极限的关键子问题。如NVIDIA近期推出的NVQlink高速互联系统,可将量子处理器与GPU超算无缝连接,实现低延迟的量子–经典混合计算。这种架构变革也呼应了当下芯片领域的异构集成趋势:芯片堆栈、3D封装等技术正在让CPU、GPU和其他加速器高度整合,量子计算将成为这种加速计算转型的一部分。总之,随着摩尔定律进入停滞期,算力行业正面临从传统通用计算向加速化计算的转折,量子计算有望成为这一转型中的关键增量节点。

06

量子计算与AI的相互赋能

一、量子计算对AI能力的提升随着AI模型向多模态、生成式等方向发展,其算力结构性瓶颈日益显现:例如AI需要处理的特征空间维度极高、优化路径受限于线性梯度下降、以及规模扩张带来爆炸级的能耗。量子计算以量子叠加态天然表达海量维度信息的能力,为AI带来一种全新的思路。

量子位可以并行承载2^n个状态,为处理高维语义嵌入和复杂关联提供更完整的信息表达;在学习阶段,量子干涉的“相位敏感性”有望更有效地区分微小模式差异,辅助图像识别、语义消歧等任务。另外,量子搜索算法(如Grover)和变分优化算法能够提供超越经典SGD的全局搜索能力,有望帮助AI模型逃离局部最优,寻找更优解。

二、AI如何赋能量子计算与此同时,AI也正在反向赋能量子计算的工程化进展。尤其在量子纠缠控制与误差抑制方面,机器学习正在成为关键工具。相比传统基于物理模型的调参方式,AI 更擅长从大量实验数据中学习出最优脉冲形状、纠缠路径与门控序列,提升量子比特之间的稳定耦合效率。在超导与离子阱等主流平台上,AI已被用于优化多比特纠缠操作,降低串扰与退相干风险;同时在误差检测与纠错逻辑中,AI 也可动态识别系统噪声,预测并抑制潜在故障。

长远来看,量子计算或将为下一代AI引入“并行非因果”的建模方式,使AI能够以更接近自然系统的方式理解世界。不过,真正通用的量子神经网络需要数千乃至数万个高保真逻辑比特和极低的误差率,目前技术距离这一目标还很遥远。因此,现在关于“量子+AI”更多是理念和初步框架的探索,行业仍处于早期研究阶段。

07

产业链与投资机会在哪里?

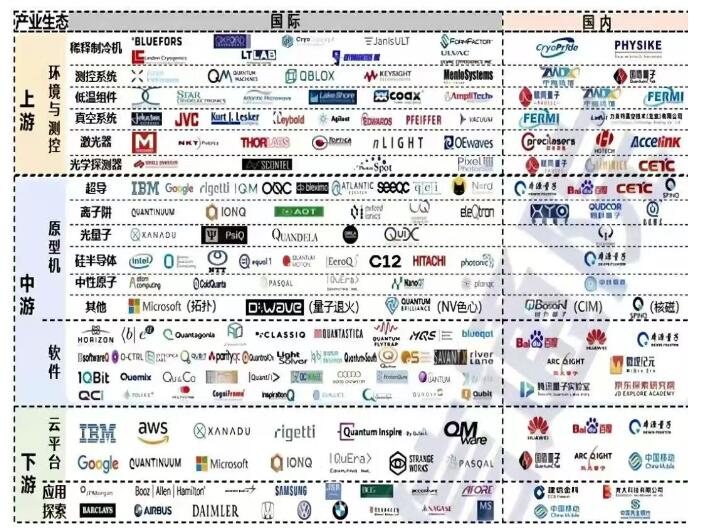

基于目前技术路径未达成行业共识、纠错难度大、成熟度不高等不确定性挑战,我们认为目前最佳的投资策略是多点布局而非单点押注:一方面要关注长期可能实现颠覆式的通用量子计算整机研发,另一方面也要“卖铲子”式押注那些确定性更高的环节。具体来看,值得重点关注的投资机会主要集中在以下四类:

量子计算整机在整机层面,我们认为单点物理指标的领先,并不足以构成可持续的长期优势。真正具备穿越技术周期能力的公司,必须同时掌握算法、硬件与软件的全栈能力。量子计算的核心瓶颈并不在于简单堆叠物理比特数量,而在于如何在高度复杂的系统中有效控制噪声、实现可扩展的纠错机制、保持长期运行稳定性,并通过成熟的软件栈将硬件能力转化为可用算力。这本质上是一个系统工程问题,而非单点物理指标的竞争。只有具备全栈能力的厂商,才更有可能在技术路线尚未收敛的阶段持续推动整机性能演进,并率先完成真实应用场景的验证,而不被单一物理路径锁死,因此更有可能在通用量子计算的长期发展中形成真正具备战略价值的竞争力。

上游零部件产业链上游的核心零部件与基础设施厂商,包括超低温制冷系统、真空系统、精密激光器、放大器及相关控制与测控设备等。这些环节的优势在于即便整机研发进展缓慢或技术路径长期无法达成共识,它们依旧可以借助科研订单、云平台部署、企业测试需求等实现持续营收,避免陷入“等技术成熟才能商业化”的被动局面,可以更快的兑现业绩。因此可以预见,在多国并行推进各种技术路线的阶段,这类基础设施设备将长期受益于持续扩张的量子产业规模。

软件与算法库中间软件与算法库层,如VQE、QAOA 等关键算法及其配套的软件工具链,这一层承担着连接底层硬件与上层行业应用的核心功能,是量子能力走向商业化的关键载体。算法与中间件具备跨硬件平台复用的潜力,一旦形成事实标准,其价值将不完全受制于某一具体硬件路线。

量子云平台下游量子云服务平台,量子云(QCaaS)是当前最具现实落地意义的商业形态之一,云平台通用性更强,对于量子技术路径依赖小,且可以与现有的传统云进行融合,因此商业化进程也会更快。IBM、AWS、Azure等已构建多路线硬件聚合的量子云平台,预计到2025 年全球QCaaS 市场规模将达到约18 亿美元。通过云服务模式向企业和科研机构提供量子计算能力,不仅降低了用户使用门槛,也将底层硬件技术演进的不确定性转化为平台层的弹性能力,使商业化节奏明显快于整机路径。

图片源自:2026年度计算机行业投资策略:产业硬件约束兑现,政策新蓝图展开

08

结语

回望第一性原理,任何计算过程本质上都是一种物理演化过程。经典计算将问题抽象成0和1的状态转移,这是人为地忽略了自然界更丰富的物理行为,而量子计算在处理高维态空间与复杂物理过程等问题上具备天然优势;从产业演进看,经典计算算力受物理与能耗约束正逐步逼近瓶颈,而量子计算算力仍处于快速爬升阶段,两者的“算力曲线”可能在未来几年出现交汇,一旦有效量子比特数量或量子体积达到临界规模,量子算力即可能出现拐点式跃增,解决此前被视为“不可解”或“成本天文”的关键问题。正如IBM高层所言:“量子计算今天的位置类似于2015年的AI”,当时正处于深度学习爆发前夜;量子算力跨过临界点后,也将迎来类似的质变。

然而,我们也必须看到量子计算依然是“非共识赛道”:不同物理实现路径各有优劣,没有一家能够同时兼顾高保真度、长相干时间、易扩展和低成本。因此,真正值得关注的,不是终局形态,而是过渡态的演化过程。对于投资者而言,这意味着需要更长的视角、更耐心的资本,更重协同的布局。量子计算不是一个纯粹的技术赌注,它更像一次跨越工程、算法、物理与系统的产业重构挑战。

未来,随着量子体积持续增长、纠错方案逐步实用,以及QPU 逐步加速嵌入主流架构,我们相信量子计算将不再是“论文中的奇点”,而是成为高价值任务中的可选项。

那一天,不是所有问题都由量子解决,而是开始有问题只能由量子解决。